Chicago: le parrain du datajournalisme?

Des premiers hackers-journalistes à la News Application Team du Chicago Tribune, le sociologue Sylvain Parasie revient sur l’essor du datajournalisme dans la ville d’Al Capone.

[Liens en anglais sauf mention contraire] Sociologues au Latts [fr], le Laboratoire Techniques, Territoires et Sociétés de l’Université Paris-Est Marne-la-Vallée, Sylvain Parisie et Éric Dagiral ont séjourné trois semaines à Chicago en septembre dernier, pour rencontrer les acteurs locaux du datajournalisme. Plus connue à cause d’Al Capone et des Incorruptibles, “la ville du crime” est l’une des villes pionnière en Amérique du Nord en matière d’utilisation des bases de données dans la production de contenu journalistique. Des premiers hackers-journalistes à la News Application Team du Chicago Tribune, en passant par ChicagoCrime.org : Sylvain Parisie revient pour Silicon Maniacs sur 15 ans de datajournalisme à Chicago.

L’idée d’utiliser des bases de données comme support à la production d’information apparaît en Amérique du nord à la fin des années 1960, notamment sous la houlette de Philip Meyer. C’est un pionner qui écrit dès 1971 un manuel, The New Precision Journalism, dans lequel il explique que les journalistes doivent utiliser des ordinateurs, mais également construire des bases de données dans un tableur pour produire l’information. Son idée est de s’inspirer des outils statistiques des sciences sociales pour produire une information en rupture avec les préjugés. Les bases de données viennent appuyer le journalisme d’investigation. En 1967, il réalise ainsi une première enquête sur des émeutes raciales dans la ville de Détroit. En utilisant un ordinateur IBM disponible à Harvard, il montre, chiffres à l’appui, que contrairement a ce qu’on pensait à l’époque les Afro-américains étudiant à l’université avaient autant de chances que les autres de participer aux émeutes.

Même si le manuel de Philip Meyer remporte un certain succès, ce modèle de journalisme ne se diffuse pas véritablement avant la deuxième moitié des années 1980. Plusieurs journalistes remportent alors des prix Pulitzer avec des enquêtes qui s’appuient sur l’utilisation de bases de données. Je pense notamment à Bill Dedman, qui obtient le prix en 1989 pour une série d’article, The color of money, sur les questions de discriminations raciales pour l’obtention de prêts bancaires.

À l’époque, l’utilisation de bases de données reste encore anecdotique. Elles sont surtout utilisées par des journalistes isolés, pour faire des coups et se faire connaître. C’est seulement à partir des années 1990 que le journalisme de données change progressivement de statut. Cette évolution est portée par l’apparition d’organisations professionnelles qui essayent de commercialiser des bases de données auprès des rédactions. La plus connue d’entre-elles est la Nicar, qui se spécialise dans ce qu’on appelle à l’époque le CAR, le Computer Assisted Reporting. Ils se proposent de collecter des bases de données, de les compiler, et de les nettoyer pour les vendre à des journaux. Ils offrent également des formations aux journalistes. À cette époque, ce spécialiste des ordinateurs et des bases de données qu’est le Computer Assisted Reporter n’est pas vraiment reconnu dans les rédactions.

La véritable rupture ne se fait pas avant le milieu des années 2000. Les grands titres comme le New York Times, le Los Angeles Times, le Chicago Tribune et le Washington Post ont déjà commencé à recruter des spécialistes, mais c’est la récupération de l’ensemble des données concernant la guerre, qui popularise ces méthodes. En 2006 par exemple, le Washington Post met en ligne l’application The Faces of the Fallen, qui tient la comptabilité de tous les militaires tués en Irak et en Afghanistan. C’est une grande base de données dans laquelle on peut voir le visage des militaires tombés au combat, savoir où ils sont nés, où ils ont grandi, connaître les circonstances et la date de leur mort. À la même époque le Washington Post publie également des données qui permettent de suivre l’activité des parlementaires américains.

Il nous est apparu qu’il y a eu véritablement trois temps dans le développement du journalisme de données à Chicago, et plus largement aux États-Unis. Un premier temps qui concerne essentiellement les organisations de presse traditionnelle, entre la fin des années 90 et le début des années 2000, avec des journalistes isolés qui utilisent des bases de données. Un second temps pendant lequel on voit apparaître de nouveaux acteurs, issus du développement web et du logiciel libre. Et enfin, un troisième temps marqué par la constitution d’équipes dédiées au sein des rédactions des grands journaux.

Nous avons rencontré Darnell Little, un pionnier du journalisme de données, à Chicago. C’est une personne fascinante, qui a une histoire et un parcours atypique. Ingénieur de formation, il travaille d’abord pour l’opérateur américain ATT, avant de se reconvertir dans la presse, dans le milieu des années 1990. Il obtient un Master de journalisme à la North Western University et est embauché au Chicago Tribune en 1996, la semaine même où le site internet du journal est lancé. Au sein de la rédaction, il sera à l’origine de grandes séries d’investigations sur des sujets qui concernent souvent la justice sociale.

Il travaille en collaboration avec les journalistes. Son travail à lui consistait à essayer de trouver les grandes lignes, les angles et des idées d’articles pertinentes, en travaillant à partir des bases de données de l’État de l’Illinois ou de la ville de Chicago. Ce sont ensuite des reporters qui vont sur le terrain pour poursuivre l’enquête. C’est une tradition que l’on connaît très peu en France : un journalisme écrit, littéraire, mais qui repose énormément sur l’exploitation statistique et de bases de données.

Les journalistes arrivent souvent avec des idées préconçues sur les gens à interviewer, sur ce qui est pertinent sur un sujet donné. Darnell Little intervenait notamment pour montrer aux journalistes qu’ils partaient avec des idées reçues, en appuyant ses arguments sur des chiffres. Ça donnait parfois lieu à des relations un peu difficiles, d’autant plus qu’à l’époque le Computer Assisted Reporter n’est pas considéré comme une personne cool. Ce n’est pas un métier sur lequel on fantasme. C’est quelqu’un qui à des compétences extraordinaires, mais tellement particulières qu’il peut être rapidement ostracisé, isolé, en étant relégué au rang de simple technicien.

À partir de 2004-2005, plusieurs initiatives émergent à Chicago. Cette fois-ci, elles ne concernent pas du tout les médias traditionnels, mais plutôt des startups, en marge du journalisme. On voit apparaître tout un ensemble de nouveaux acteurs issus du développement web: des militants pour l’ouverture des données, des informaticiens et des hackers. Ils essayent de construire quelque chose de nouveaux à l’intersection de la presse et de l’open data. Tout ces gens-là ont des pieds dans différents mondes: celui de la presse, du développement, parfois même des institutions, de la mairie. C’est notamment le cas d’Adrian Holovaty, le fondateur de Chicago Crimes en 2005, puis d’EveryBlock.

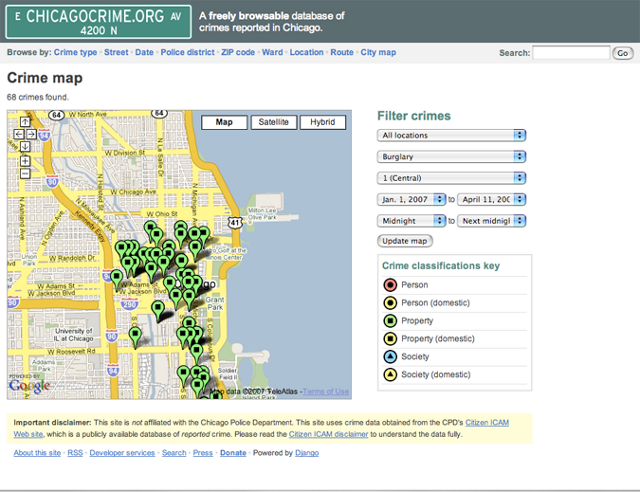

En 2005, Chicago Crimes est l’un des premiers mashups qui permet de géolocaliser sur une carte les données criminelles (homicides, agression, vol…), qui sont diffusées par le site du Chicago police département depuis 1996. Les données existaient, mais elles étaient classées d’une manière qui les rendait très difficiles à comprendre et à analyser. De plus, elles n’étaient disponibles que pendant deux semaines. Adrian Holovaty va « hacker » ces données. Il les interface sur une carte Google – ce qui est déjà en soit une performance puisque l’API de Google Map n’était pas encore ouverte à cette époque -, les archive, mais crée également de nouvelles catégories, pour les rendre plus exploitables. Il était dès lors possible d’afficher les crimes par zones d’habitation. À cette époque là, c’est un gros coup.

L’image des hackers s’améliore. Ils acquièrent un rôle social beaucoup plus ouvert, avec un message politique, citoyen. Ils veulent permettre à tout le monde d’accéder facilement à l’information et aux données. Adrian Holovaty est déjà un développeur reconnu dans la communauté. Avec Chicago Crimes, il se fait une réputation non seulement à Chicago, mais également en Amérique du Nord.

Au départ, c’est effectivement un journaliste. Il a notamment travaillé au Washington Post. La légitimité de ces acteurs vient également des fondations qui les soutiennent. La Knight Fondation, par exemple, a financé à hauteur de plusieurs millions de dollars Adrian Holovaty pour le développement de EveryBlock. Chicago Crimes était l’œuvre d’une personne, EveryBlock est celle d’une équipe.

Là ou Chicago Crimes reprenait simplement les données policières, EveryBlock étend le principe. On a accès à un ensemble de données et d’informations relatives à sa situation géographique. Ça concerne évidement les crimes, les homicides, mais également, par exemple, les ouvertures de commerces, les transactions immobilières, les licences de débit d’alcool… EveryBlock agrège un ensemble d’informations disponibles en ligne et les centralise à l’échelle d’un quartier (« block »), d’une rue. C’est la même choses pour tous les avis concernant les restaurants du coin du quartier, ou des photos postées sur Flickr.

Pour ce type de site, toute la difficulté réside dans la récupération des données. Ils nous ont raconté à quel point c’était difficile, même à Chicago. Pour eux, l’enjeu est d’être en mesure d’avoir des données qui répondent à deux qualités : d’abord qu’elles soient soutenables, c’est à dire mises à jour régulièrement et toujours de même qualité, ensuite, qu’elles soient granulaires, c’est à dire qu’elles correspondent à un emplacement extrêmement précis dans un quartier, dans la ville. Contrairement à la France, ce modèle journalistique est totalement reconnu en Amérique du Nord. Le site s’est monté à Chicago et s’est rapidement étendu à d’autres villes avant d’être racheté par MSN en août 2009.

En 2009 à Chicago, la situation était assez catastrophique pour la presse. Le Chicago Tribune est lui-même déclaré en faillite, fin 2008. Il se relève malgré tout et décide contre toute attente, mi-2009, de recruter des hackers-journalistes pour lancer une News Application Team de quatre personnes. Ces nouveaux journalistes viennent du monde de l’open data, du développement web et ont souvent une formation en journalisme. Ils sont recrutés pour faire des applications, de la visualisation et traiter des données. Ils doivent servir d’appui au journalisme d’investigation. Derrière cette News application Team, il y a donc un projet de journalisme ambitieux.

Les médias historiques ont une approche très différente du journalisme de données. Les journalistes traditionnels reprochaient souvent à des sites comme EveryBlock, le fait de simplement diffuser des données, sans les mettre en perspective. Dans la presse traditionnelle, on observe donc une forme de compromis : on mêle la mise à disposition des données, l’investigation et le cadrage journalistique. Le Chicago Tribune a par exemple réalisé une enquête sur les maisons de retraite, avec une série de papiers très fouillés sur les personnes victimes d’abus, mais également un moteur de recherche qui permet aux lecteurs de savoir quelles sont les caractéristiques des maisons de retraite dans lesquelles ils ont placé leurs parents ou leurs beaux parents. C’est également le même procédé qui a été employé dans une autre enquête du Chicago Tribune sur l’Agent Orange utilisé lors de la guerre du Vietnam.

Il y a de ça, en partie. Le datajournalisme permet de développer une certaine proximité avec le lecteur. On traite l’information à l’échelle des personnes individuelles, de leur quartier, voisinage. Le datajournalisme participe à un mouvement qui voudrait qu’une des solutions à la crise de la presse soit de renouveler l’intérêt des lecteurs en parlant de chose ultra-proches de lui. Là ou il faut tempérer, c’est que ces hackers-journalistes ont été recrutés pour assister les journalistes d’investigation. Ces formats sont loin d’être ceux qui font le plus d’audience. Mais, ils apportent beaucoup en terme de crédibilité et de notoriété, d’image pour le journal… C’est à la fois une composante hyperlocale, mais également une composante de prestige.

Nos Députés.fr est effectivement porté par des gens qui viennent du développement web, du logiciel libre et qui ont une vraie implication citoyenne. Mais, il n’y a quasiment aucune connexion avec la presse, à part une enquête avec Médiapart et quelques partenariats très ponctuels. On est très loin des États-Unis où c’est le Washington Post lui-même diffuse les données sur le travail des sénateurs américains.

Le cas d’OWNI est très différent. D’abord, il est beaucoup plus récent. Cependant, c’est effectivement une tentative très originale de construire un pont entre le journalisme traditionnel et la mise à disposition des données. Évidement, on reste à la marge, mais cette fois ci on n’est plus en dehors du journalisme. Le prix remis en octobre dernier à OWNI par la Online News Association (ONA) participe à la reconnaissance de ce site, mais cette légitimité joue plutôt au niveau international pour l’instant.

Déjà, il n’y a pas en France de fondations pour l’innovation, qui soutiennent financièrement de tels projets innovants. Nous avons beaucoup d’aides à la presse en France, mais elles ne fonctionnent pas de la même manière et ne touchent pas les acteurs à la marge. Ensuite, la presse traditionnelle a été assez peu sensible au développement du datajournalisme. Mais, on peut être surpris. Ce serait totalement logique qu’un site comme LeMonde.fr se rapproche de NosDéputés.fr, par exemple.

Enfin une difficulté supplémentaire dans le cas français est le manque de disponibilité des données. Pour que le datajournalisme se développe, il faut d’abord faciliter l’accès aux données. Je prend l’exemple du Figaro : il y a quelques semaines, le titre a lancé une enquête concernant les maisons de retraites. Elle s’accompagne d’une visualisation [fr] dans laquelle ont peut parcourir, département par département, un classement des maisons de retraite. La différence entre le traitement de ce sujet par Le Figaro et le Chicago Tribune, c’est la méthode utilisée pour récupérer des données. Le Figaro a envoyé un questionnaire aux maisons de retraite. À Chicago, ce sont des statistiques de l’État de l’Illinois qui ont été croisées avec des données policières. Tout est dit. On ne peut pas avoir la même qualité des données quand on demande aux maisons de retraites de se positionner elles-même.

En France, les données disponibles sont essentiellement nationales. De ce qu’on a pu observer à Chicago, les récits qui fonctionnent le mieux sont ceux qui sont ancrés localement. C’est typiquement de genre de données qui est très difficile à collecter en France. C’est possible, mais ça demande énormément de temps et de travail.

Un des autres enseignements de notre enquête est la spécialisation des acteurs. Il y a des experts du traitement de données, mais également des personnes qui se spécialisent dans la récupération de données. On les appelle les « People Person ». Leur travail quotidien consiste à « harceler » les autorité pour récupérer des données exploitables. Étant donné la différence des cultures entre la France et les États-Unis, beaucoup de journalistes sont moins sensibilisés à la valeurs que peuvent représenter des données brutes. Je pense malgré tout qu’un mouvement est amorcé. Les journaux commencent à mesurer l’intérêt qu’il peuvent tirer de se positionner sur ces formats journalistiques.

>> Article initialement publié sur Silicon Maniacs.

>> Photo Flickr ![]()

![]()

![]() par alamodestuff.

par alamodestuff.

Laisser un commentaire